Nylig hadde Tromsø kommune en flau opplevelse da KI-løsningen de brukte fant opp fagreferanser som ikke finnes. Selv har jeg de siste dagene fått en egen viktig påminnelse om at vi skal bruke svarene fra KI med varsomhet.

Tromsø kommune skal revidere skolestrukturen og sendte ut et 120 siders kunnskapsgrunnlag. Så viste det seg at bare 7 av de 18 kildene i dokumentet lot seg spore opp. To av kildene var bøker av professorer i pedagogikk. Problemet var bare at de to bøkene ikke finnes.

Det viste seg at kommunen hadde brukt KI for å få hjelp til å skrive kunnskapsgrunnlaget, uten å sjekke svarene – i dette tilfellet kildehenvisningene – godt nok. Dette fikk Aftenpostens Joacim Lund til å skrive en bitende kommentar med tittelen Kunstig intelligens kan ikke veie opp for ekte dumskap:

«Akkurat som hos mennesker, sitter bare det viktigste igjen etter at KI-modellene er opplært. Forskjellen – og problemet – er at når modellene blir bedt om å gjengi noe de ikke husker, vil de ofte bare finne på detaljer for å tette hullene.»

Hva var det egentlig som hadde skjedd? I fagspråket kalles det hallusinering. Og det er faktisk ikke en feil med teknologien, men en viktig funksjon som gjør generativ KI i stand til å være kreativ; den tolker ut fra de kildene den finner om hva som må være f.eks. svaret på det du spør om selv om svaret ikke finnes eksplisitt i kildene.

Her er en god artikkel fra Areca som forklarer nærmere hva dette handler om. Poenget er, som det står i artikkelen, at uten hallusinering vil ikke KI være i stand til å gi deg svar som ikke finnes i treningsdataene fra før. Men:

«Problemet med hallusinering dukker opp når vi ber om et faktasvar, og ikke ønsker at modellen skal være kreativ. Kunstig intelligens vet ikke forskjellen på riktig og galt, fakta og fantasi, løgn og sannhet. Når du spør om noe den ikke finner svaret på i treingsdataene sine (eller andre kilder), vil den forsøke å konstruere et svar med ord som den beregner seg fram til basert på spørsmålet ditt, akkurat som den gjør når du ber den om å skrive et dikt. Hvis det du spurte om krever et faktasvar, vil svaret den kunstige intelligensen kontruerer ofte være feil.»

Så da er vi tilbake til den eldgamle akademiske disiplinen: Vær kritisk til det du får og sjekk resultatet. Og så kan vi jo håpe på at utviklingen av språkmodeller om ikke så lenge kommer dit at vi enkelt kan gi dem beskjed om å holde seg til fakta. Eller at de blir så smarte at de selv skjønner når de ikke skal lage kreative svar på egenhånd.

Hallusinering, i følge Norsk helseinformasjon: …en sanseopplevelse uten at det foreligger en ytre påvirkning av sanseorganet. F.eks. at du hører og ser ting som ikke eksisterer eller er virkelige.

Min egen erfaring med hallusinering

Jeg har de siste månedene brukt ChatGPT (pluss-versjonen) som hjelper i arbeidet med både fagartikler og manus til blant annet e-læringskurs. Det har vært nyttig og jeg synes at KI ofte gir meg gode råtekster å jobbe videre med. Samtidig synes jeg at tekstene som tekster oftest er veldig bra: god struktur, godt og enkelt språk, og tydelige framstillinger uten for mye snikksnakk.

Så har de siste par ukene altså fått en påminnelse om å være varsom med å bruke de svarene KI gir meg. Jeg holder på med manus til et e-læringskurs for medlemmer i forliksråd. Det er mye juss her og en del av manusarbeidet handler om å vise til riktige lovbestemmelser og fortolke disse på en måte som også personer uten juridisk fagbakgrunn kan forstå. Jeg har en god fagbok om dette, skrevet av dommere og advokater, men noen ganger trenger jeg utdypinger, fortolkninger, eksempler og enkle sammendrag som boken ikke gir. Da bruker jeg KI.

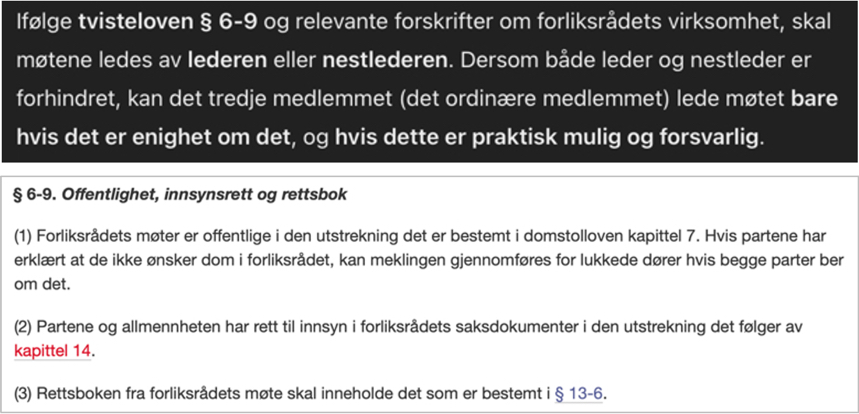

Nå har jeg opplevd flere tilfeller hvor ChatGPT viser til feil lovbestemmelser. Et eksempel: Jeg spurte ChatGPT om det alltid må være lederen i forliksrådet som leder rettesmøter eller om noen av de andre medlemmene også kan gjøre dette. ChatGPT svarte (øverst) at ifølge tvisteloven § 6-9 skal møtene ledes av leder eller nestleder (for øvrig: ordet nestleder brukes ikke i forliksråd). Nederst står § 6-9, i Lovdata. Paragrafen sier ingenting om ledelse av møtene, men handler om helt andre ting. Det står faktisk ingenting om ledelse av møtene i tvisteloven, og heller ikke i domstolloven, som ville vært den andre mulige kilden her. Så her har ChatGPT hallusinert.

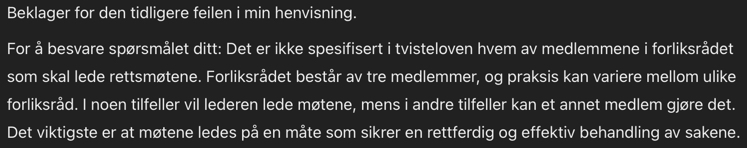

Når jeg kommenterer at det ikke står noe i tvisteloven § 6-9 om hvem som skal lede møtene, kommer ChatGPT på andre tanker og svarer:

Lignende feil har jeg opplevd flere ganger. ChatGPT både henviser til feil lovbestemmelser, henviser til bestemmelser som ikke finnes i det hele tatt eller trekker konklusjoner som jeg ikke kan finne dekning for i min autorative fagbok om temaet.

Juss er et fagfelt hvor det er særdeles viktig ikke å fare med feil og unøyaktigheter. Og det samme gjelder på mange andre fagfelt også, for eksempel når det skal lages kunnskapsgrunnlag om skolestrukturen i en kommune. For min del har denne erfaringen ført til at jeg i arbeid som dette har begynt å skrive flere prompter (spørsmål/dialog) for å borre grundigere i svarene som ChatGPT gir meg. Jeg sjekker svarene mot andre kilder, ber om kildehenvisninger og ber om utdypninger, f.eks. «Du skriver at… Kan du forklare dette nærmere og også se dette i forhold til…?» Det er et mer møysommelig arbeid enn om jeg bare kunne brukt direkte det ChatGPT svarte meg første gang, men det er et nødvendig arbeid.

Se for øvrig min bloggartikkel fra noen uker tilbake om hva KI kan brukes til i kompetansearbeidet.